EU AI Act 2026: Ab Sommer müssen Sie das wissen

EU AI Act 2026: Die neue Ära der künstlichen Intelligenz in Europa

In der digitalen Landschaft bricht diesen Sommer eine neue Zeitrechnung an. Während künstliche Intelligenz in den letzten Jahren oft in einem rechtlichen Graubereich operierte, schafft die Europäische Union nun mit dem EU AI Act (KI-Gesetz) den weltweit ersten umfassenden Rechtsrahmen für diese Technologie.

Ab Sommer 2026 werden die zentralen Bestimmungen des Gesetzes für die meisten Unternehmen und Entwickler "schlagend". Das Ziel ist klar: Innovation fördern und gleichzeitig die Grundrechte der Bürger schützen. Dabei setzt die EU auf einen risikobasierten Ansatz, der KI-Systeme in verschiedene Kategorien unterteilt – je nachdem, wie groß das potenzielle Gefahrenpotenzial für den Menschen ist.

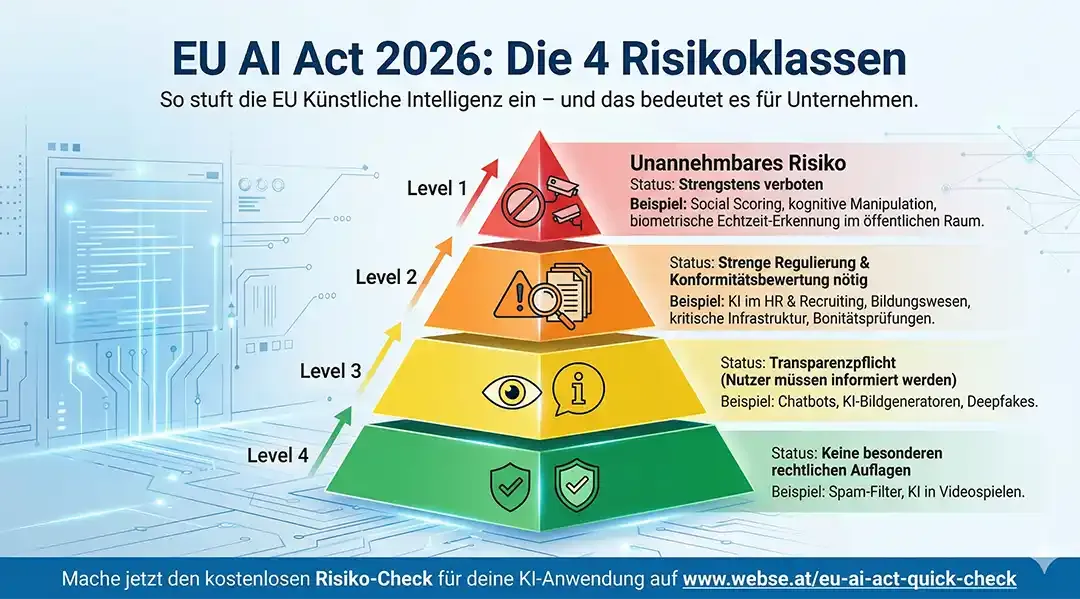

Ein Gesetz, vier Risikoklassen

Das Herzstück des AI Acts ist die Einstufung von Anwendungen nach ihrem Risiko. Je höher das Risiko für die Sicherheit oder die Grundrechte, desto strenger sind die Anforderungen an die Transparenz und die technische Dokumentation.

Die Einteilung erfolgt in vier Stufen:

- Unannehmbares Risiko: Anwendungen, die als Bedrohung gelten (z. B. Social Scoring durch Regierungen), werden komplett verboten.

- Hohes Risiko: KI in kritischen Infrastrukturen, Bildung oder im Personalwesen. Diese Systeme unterliegen strengsten Kontroll- und Konformitätspflichten.

- Geringes Risiko: Hierzu zählen etwa Chatbots oder Bildgeneratoren. Hier stehen Transparenzpflichten im Vordergrund (Nutzer müssen wissen, dass sie mit einer KI interagieren).

- Minimales Risiko: Anwendungen wie KI-gestützte Videospiele oder Spam-Filter. Hier ändert sich rechtlich kaum etwas.

Warum der Sommer 2026 der entscheidende Wendepunkt ist

Obwohl das Gesetz bereits schrittweise eingeführt wurde, endet im Sommer 2026 die wichtigste Übergangsfrist. Ab diesem Zeitpunkt müssen Unternehmen, die "Hochrisiko-KI-Systeme" betreiben oder in die EU importieren, die volle Konformität nachweisen. Das bedeutet: Risikomanagement-Systeme müssen etabliert, Datenqualität gesichert und die menschliche Aufsicht garantiert sein.

Was sich für dich und dein Unternehmen konkret ändert:

- Transparenz: KI-generierte Inhalte (Deepfakes, Texte, Bilder) müssen künftig klar als solche gekennzeichnet werden.

- Dokumentation: Entwickler müssen technische Dokumentationen bereitstellen, die erklären, wie die KI trainiert wurde und wie sie Entscheidungen trifft.

- Haftung: Bei Verstößen drohen empfindliche Bußgelder, die – ähnlich wie bei der DSGVO – einen erheblichen Prozentsatz des weltweiten Jahresumsatzes ausmachen können.

Die vier Säulen der Compliance

Um sicherzustellen, dass deine KI-Anwendung den neuen Standards entspricht, solltest du auf folgende Bereiche achten:

Transparenz & Kennzeichnung

- Output-Labeling: Nutzer müssen erkennen, dass ein Inhalt KI-generiert ist.

- Chatbot-Hinweis: Es muss sofort ersichtlich sein, dass kein Mensch antwortet.

- Urheberrecht: Zusammenfassungen von urheberrechtlich geschützten Trainingsdaten müssen offengelegt werden.

Qualität & Sicherheit

- Daten-Governance: Trainingsdaten müssen repräsentativ und frei von Diskriminierung sein.

- Menschliche Aufsicht: Kritische Entscheidungen müssen von Menschen überprüft werden können.

- Cybersecurity: Schutz vor Manipulationen und "Adversarial Attacks".

Innovation trotz Regulierung: Eine Chance für Europa?

Kritiker fürchten, dass die strengen Regeln die Innovationskraft bremsen könnten. Doch viele Experten sehen im EU AI Act auch einen massiven Standortvorteil. Durch klare Regeln entsteht Rechtssicherheit. Du weißt genau, unter welchen Bedingungen du KI einsetzen kannst, ohne rechtliche Konsequenzen fürchten zu müssen.

Zudem etabliert die EU mit dem "AI Office" eine zentrale Aufsichtsbehörde, die die Einhaltung überwacht und gleichzeitig Unternehmen bei der Umsetzung berät. Es geht also nicht nur um Verbote, sondern um die Schaffung eines vertrauenswürdigen "AI Made in Europe"-Siegels.

Fazit: Vorbereitung ist alles

Der EU AI Act ist kein Hindernis, sondern die Hausordnung für das digitale Zeitalter. Unternehmen, die jetzt ihre Prozesse analysieren und ihre KI-Anwendungen auf Transparenz und Sicherheit trimmen, werden langfristig profitieren. Wer die Übergangsfrist bis zum Sommer nutzt, sichert sich einen Vorsprung im Wettbewerb um das Vertrauen der Nutzer.

Bist du bereit für den Sommer 2026?

Fällt dein Projekt unter "Hochrisiko" oder reichen einfache Transparenzhinweise? Mach jetzt unseren interaktiven Quick-Check und erhalte sofort deine Auswertung.

Zum kostenlosen Risiko-Check →

![]()

WEBSE-Lexikon:

- GPAI (General Purpose AI): KI-Modelle mit allgemeinem Verwendungszweck (wie GPT-4), die für viele verschiedene Aufgaben eingesetzt werden können. Sie unterliegen speziellen Transparenzregeln.

- Konformitätsbewertung: Ein Verfahren, mit dem nachgewiesen wird, dass ein Hochrisiko-KI-System alle Anforderungen des AI Acts erfüllt, bevor es auf den Markt kommt.

- Deepfake-Kennzeichnung: Die rechtliche Pflicht, KI-manipulierte Bilder, Audios oder Videos so zu markieren, dass ein normaler Nutzer den Unterschied zur Realität sofort erkennt.

- Sandboxing: Kontrollierte Testumgebungen, die von Behörden bereitgestellt werden, um innovative KI-Systeme vor der Markteinführung unter realen Bedingungen, aber ohne volles Haftungsrisiko zu testen.

- Risikomanagementsystem: Ein kontinuierlicher Prozess, um potenzielle Gefahren einer KI während ihres gesamten Lebenszyklus zu identifizieren, zu analysieren und zu minimieren.

Fragen zu deinem Projekt?

Erzähl uns, woran du arbeitest. Wir schauen es uns an und melden uns.

Projekt besprechen